ALIBUNGKER - Jika Anda kesulitan mengikuti rilis model open-weight bulan ini, artikel ini akan membantu Anda mengejar tema-tema utama.

Dalam artikel ini, saya akan memandu Anda melalui sepuluh rilis utama secara kronologis, dengan fokus pada persamaan dan perbedaan arsitektur:

- Arcee AI's Trinity Large (27 Januari 2026)

- Moonshot AI's Kimi K2.5 (27 Januari 2026)

- StepFun Step 3.5 Flash (1 Februari 2026)

- Qwen3-Coder-Next (3 Februari 2026)

- z.AI's GLM-5 (12 Februari 2026)

- MiniMax M2.5 (12 Februari 2026)

- Nanbeige 4.1 3B (13 Februari 2026)

- Qwen 3.5 (15 Februari 2026)

- Ant Group's Ling 2.5 1T & Ring 2.5 1T (16 Februari 2026)

- Cohere's Tiny Aya (17 Februari 2026)

(Catatan: DeepSeek V4 akan ditambahkan setelah dirilis.)

1. Arcee AI's Trinity Large (27 Januari 2026)

Pada 27 Januari, Arcee AI mulai merilis versi LLM Trinity Large open-weight 400B mereka di model hub, bersama dengan dua varian yang lebih kecil:

- Model besar flagship: 400B param Mixture-of-Experts (MoE) dengan 13B parameter aktif

- Trinity Mini: 26B dengan 3B parameter aktif

- Trinity Nano: 6B dengan 1B parameter aktif

Fitur Arsitektur Utama:

Sliding Window Attention (SWA)

Trinity menggunakan alternating local:global attention layers seperti Gemma 3 dan Olmo 3. SWA adalah jenis pola attention sparse di mana setiap token hanya memperhatikan window ukuran tetap dari token terbaru (misalnya, 4096) alih-alih seluruh input.

Rasio: 3:1 local:global (mirip Olmo 3) dengan window size 4096.

QK-Norm dan NoPE

- QK-Norm: Menerapkan RMSNorm pada keys dan queries untuk menstabilkan training

- NoPE: No Positional Embeddings di global attention layers (mirip SmolLM3)

Gated Attention

Trinity menggunakan gated attention dengan elementwise gating pada scaled dot-product sebelum output linear projection. Ini mengurangi attention sinks dan meningkatkan generalisasi sequence panjang.

Depth-Scaled RMSNorm

Gain dari RMSNorm kedua di-set ke sekitar 1/sqrt(L) dengan L = jumlah total layer. Jadi, early in training, residual update dimulai kecil dan tumbuh saat model mempelajari skala yang tepat.

2. Moonshot AI's Kimi K2.5 (27 Januari 2026)

Kimi K2.5 adalah model open-weight yang menetapkan plafon performa baru pada saat rilisnya. Menurut benchmark dalam technical report, sejajar dengan model proprietary terkemuka.

Spesifikasi:

- Ukuran: 1 triliun parameter (2.5x lebih besar dari Trinity)

- Arsitektur: Mirip Kimi K2, versi scaled-up dari DeepSeek V3

- Multimodal: Mendukung vision dengan early fusion

Multimodal Training:

Kimi K2.5 adalah model multimodal native yang dibangun di atas Kimi K2 melalui large-scale joint pre-training pada sekitar 15 triliun mixed visual dan text tokens.

Tim mengadopsi pendekatan early fusion, memasukkan vision tokens sejak awal bersama text tokens. Ablation study menunjukkan model mendapat manfaat dari melihat vision tokens sejak awal pre-training.

3. StepFun Step 3.5 Flash (1 Februari 2026)

Step 3.5 Flash adalah model 196B parameter yang 3x lebih kecil dari DeepSeek V3.2 (671B) namun sedikit unggul dalam benchmark performa.

Performa:

- Throughput: 100 tokens/sec pada 128k context length

- Perbandingan: DeepSeek V3.2 hanya 33 tokens/sec pada Hopper GPUs

Fitur Utama:

Multi-Token Prediction (MTP)

Teknik yang melatih LLM untuk memprediksi multiple future tokens di setiap langkah, bukan hanya satu. Pada setiap posisi t, small extra heads menghasilkan logits untuk t+1...t+k.

Step 3.5 Flash: Menggunakan MTP-3 (3 additional tokens) selama training DAN inference - ini pengecualian karena MTP biasanya tidak digunakan saat inference.

Gated Attention

Mirip dengan yang digunakan di Trinity untuk meningkatkan performa.

4. Qwen3-Coder-Next (3 Februari 2026)

Model 80B (3B parameters active) yang membuat berita besar karena mengungguli model yang jauh lebih besar seperti DeepSeek V3.2 (37B active) pada tugas coding.

Pencapaian:

- Performa SWE-Bench Pro sejajar dengan Claude Sonnet 4.5

- Hanya sedikit di bawah Claude Opus 4.5

- Storage: 48.2 GB, RAM: 51 GB (via ollama)

Arsitektur Inovatif:

Gated DeltaNet + Gated Attention Hybrid

Mengganti regular attention mechanism dengan hybrid dalam rasio 3:1:

- Gated DeltaNet: Mengganti attention dengan fast-weight delta rule update. Menawarkan efisiensi memori untuk context panjang.

- Gated Attention: Standard scaled-dot-product attention dengan tweaks:

- Output gate (sigmoid-controlled)

- Zero-centered RMSNorm untuk QKNorm

- Partial RoPE

Hasil: Native 262k token context length (model sebelumnya hanya 32k native)

MoE Design

Meskipun 3x lebih kecil dari Qwen3 235B-A22B, Qwen3-Next memperkenalkan 4x lebih banyak experts dan shared expert.

5. z.AI's GLM-5 (12 Februari 2026)

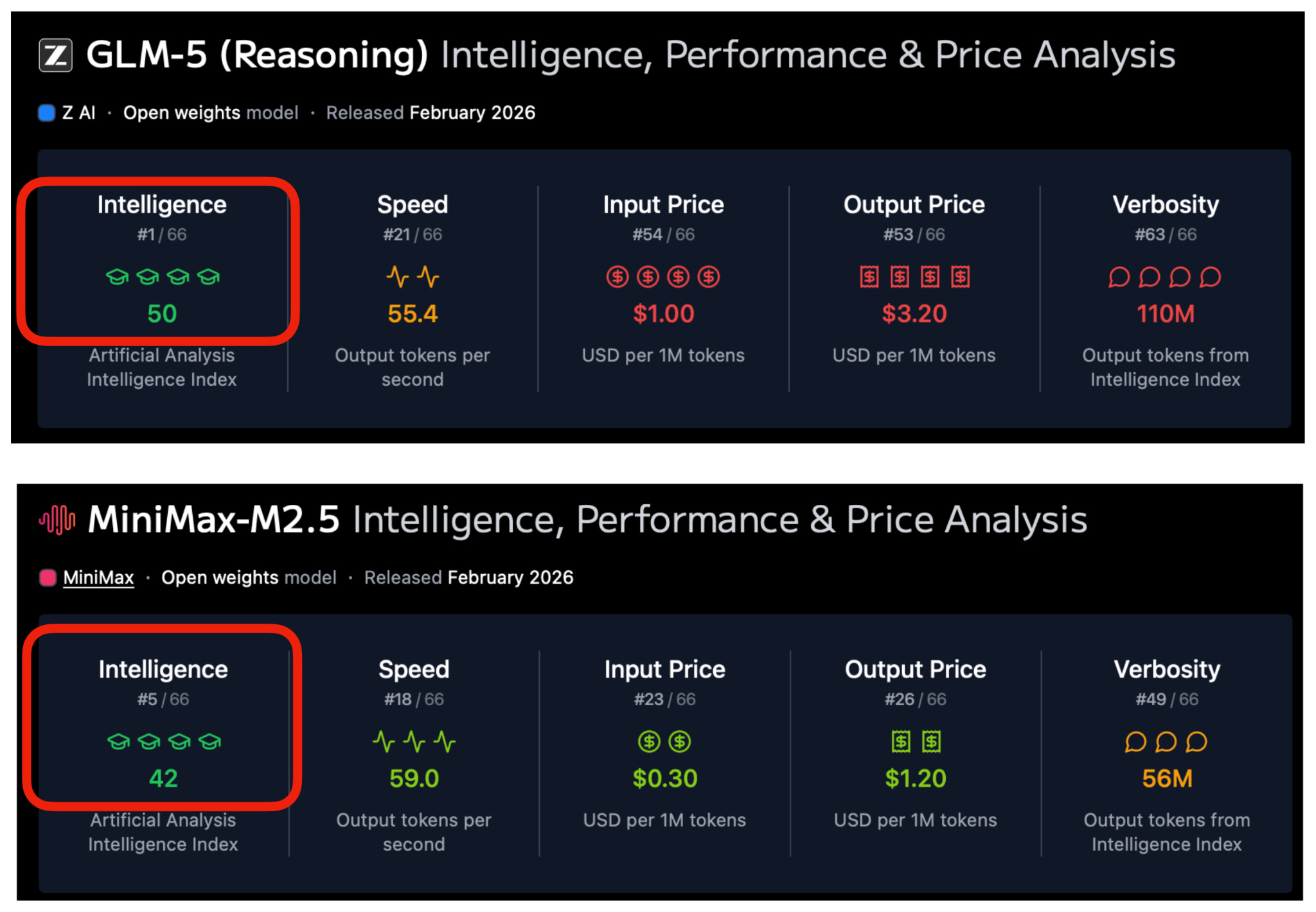

Rilis GLM-5 adalah besar karena pada saat rilis tampak sejajar dengan flagship LLM utama, termasuk GPT-5.2 extra-high, Gemini Pro 3, dan Claude 4.6 Opus.

Spesifikasi:

- Ukuran: 744B parameter (naik dari 355B di GLM-4.7)

- Active params: 40B per token (naik dari 32B)

- Experts: 256 (naik dari 160)

- Layers: 78 (turun dari 92 untuk mengurangi inference costs)

Fitur Arsitektur:

DeepSeek Multi-head Latent Attention

Mengadopsi multi-head latent attention dari DeepSeek untuk efisiensi.

DeepSeek Sparse Attention

Dimaksudkan untuk mengurangi inference costs saat bekerja dengan context panjang.

Performa Benchmark:

Berdasarkan Artificial Intelligence Index yang mengagregasi berbagai benchmark, GLM-5 sedikit lebih unggul dari Kimi K2.5 dan hanya satu poin di belakang GPT-5.2 (xhigh) dan Claude Sonnet 4.6.

6. MiniMax M2.5 (12 Februari 2026)

GLM-5 dan Kimi K2.5 adalah model open-weight populer, tetapi menurut statistik OpenRouter, mereka pucat dibandingkan dengan MiniMax M2.5 yang juga dirilis pada 12 Februari.

(Detail arsitektur MiniMax M2.5 akan ditambahkan saat informasi lebih lengkap tersedia.)

7. Nanbeige 4.1 3B (13 Februari 2026)

Model compact 3B parameter yang menunjukkan bahwa ukuran bukan segalanya dalam performa LLM.

(Informasi lebih detail akan ditambahkan.)

8. Qwen 3.5 (15 Februari 2026)

Update terbaru dari seri Qwen dengan peningkatan performa dan efisiensi.

(Detail arsitektur akan ditambahkan.)

9. Ant Group's Ling 2.5 1T & Ring 2.5 1T (16 Februari 2026)

Dua model besar 1 triliun parameter dari Ant Group yang menunjukkan skala baru dalam LLM development.

(Informasi lebih detail akan ditambahkan.)

10. Cohere's Tiny Aya (17 Februari 2026)

Model compact dari Cohere yang fokus pada efisiensi dan multilingual capabilities.

(Detail akan ditambahkan.)

Tema-Tema Utama Januari-Februari 2026

1. Mixture-of-Experts (MoE) Dominance

Hampir semua model besar menggunakan MoE untuk efisiensi, memungkinkan model dengan ratusan miliar parameter tetapi hanya aktivasi puluhan miliar per token.

2. Attention Innovation

- Sliding Window Attention: Untuk efisiensi context panjang

- Gated Attention: Untuk stabilitas dan performa

- Gated DeltaNet: Alternatif linear-time untuk attention tradisional

- Multi-head Latent Attention: Dari DeepSeek, diadopsi secara luas

3. Multi-Token Prediction

Teknik training yang memprediksi multiple future tokens semakin populer, dengan beberapa model bahkan menggunakannya saat inference untuk throughput yang lebih tinggi.

4. Scale vs Efficiency Trade-off

Model seperti Step 3.5 Flash menunjukkan bahwa arsitektur yang lebih efisien bisa mengungguli model yang lebih besar dalam throughput praktis.

5. Multimodal Integration

Model seperti Kimi K2.5 menunjukkan bahwa early fusion dalam pre-training multimodal memberikan hasil yang lebih baik.

Kesimpulan

Bulan Januari-Februari 2026 menunjukkan evolusi cepat dalam arsitektur LLM open-weight. Beberapa tren yang jelas:

- MoE menjadi standar untuk model besar

- Attention mechanisms terus berinovasi untuk efisiensi

- Performa open-weight semakin mendekati atau bahkan menyamai model proprietary

- Fokus pada inference efficiency melalui berbagai teknik arsitektur

Dengan DeepSeek V4 yang akan segera rilis, kita dapat mengharapkan inovasi lebih lanjut dalam bulan-bulan mendatang. Era LLM open-weight memasuki "musim semi" dengan kemajuan yang menggembirakan.

Referensi

- Artikel Original oleh Sebastian Raschka

- Technical reports dari masing-masing model

- OpenRouter rankings

- Artificial Intelligence Index

Sumber: Sebastian Raschka Magazine

0 Comments

Terima kasih atas komentarnya

Emoji